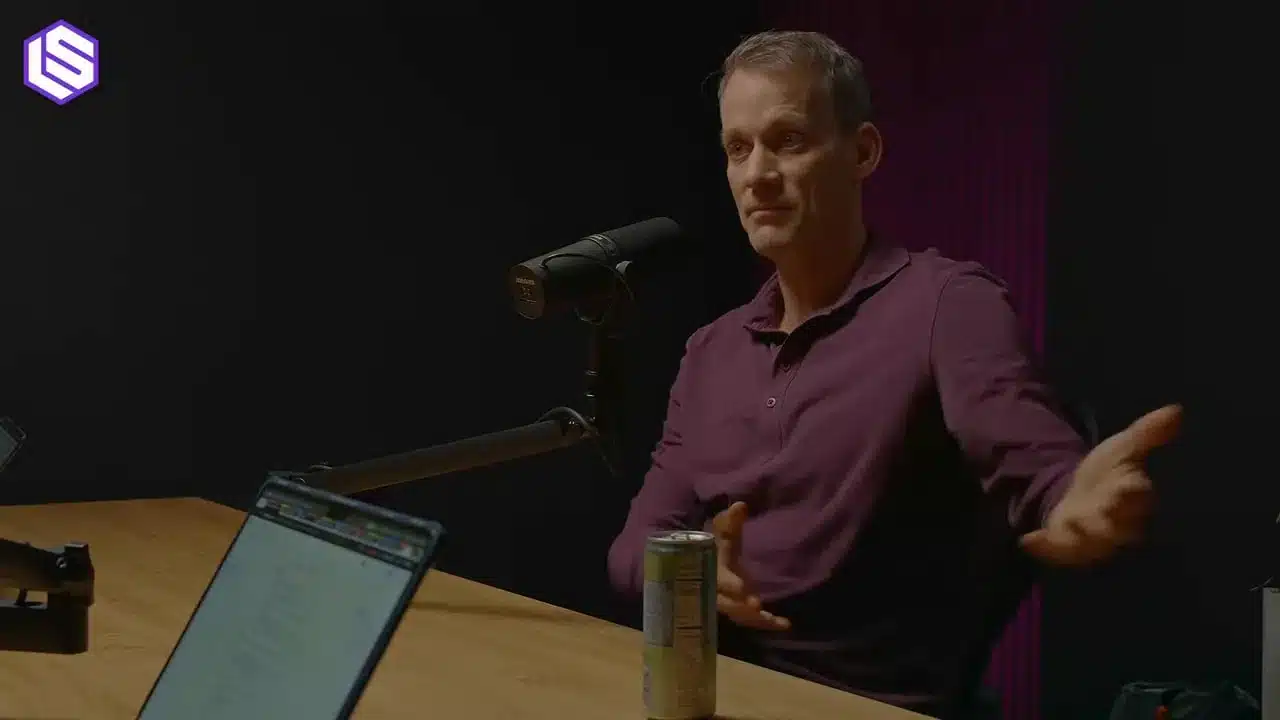

Interview mit Jeff Dean, Chief AI Scientist bei Google – über Google’s ranking prozess, Gemini, Distillation und TPU-Co‑Design

Google’s ranking process steht im Zentrum moderner Informationssysteme. In diesem Gespräch erklärt Jeff Dean, wie die Kombination aus Hardware, Algorithmen und Systemdesign die heutigen großen multimodalen Modelle ermöglicht — von Frontier‑Modellen bis zu kosteneffizienten Flash‑Modellen — und warum Distillation, Energieoptimierung und Retrieval die nächsten großen Hebel sind.

Inhaltsverzeichnis

ToggleInhaltsverzeichnis

- Kurzüberblick

- Interview (Frage und Antwort)

- Konkrete Lehren und Prinzipien

- Fallstudie: Von Sharded Indexen zur In‑Memory‑Search

- Schlussgedanken

- FAQ

- Weiterführende Ressourcen

Kurzüberblick

Jeff Dean spricht über: die Balance zwischen Spitzenleistung und Breitenverfügbarkeit, die Rolle der Distillation beim Übertragen von Fähigkeiten von großen zu kleineren Modellen, die Bedeutung von Latenz und Energie (gemessen in picojoule), das Co‑Design von TPUs mit Forschungsanforderungen sowie die Idee, dass künftige Systeme die Illusion erzeugen, sie könnten auf Billionen von Tokens gleichzeitig achten.

Interview (Frage und Antwort)

Wie entscheiden Sie bei Google zwischen Frontier‑Modellen und leichtgewichtigen, leistungsfähigen Flash‑Modellen?

Wir brauchen beides. Frontier‑Modelle zeigen, welche neuen Fähigkeiten überhaupt möglich sind. Sie treiben die Forschung voran und sind die Quelle, aus der wir per Distillation die kleineren Modelle kräftigen. Flash‑Modelle sind wirtschaftlich und niedrig automatisiert in der Latenz. Für viele Produktfälle ist Flachpreis und niedrige Latenz wichtiger als die letzten Prozentpunkte an Qualität.

Distillation ist zentral: anstatt ein Ensemble von Dutzenden Experten live zu betreiben, trainiert man ein großes Modell oder mehrere spezialisierte Modelle und „komprimiert“ deren Verhalten in ein kleineres Modell. Die Logits des großen Modells liefern weiche Aufsichten, die dem kleinen Modell ermöglichen, fast die gleiche Leistung zu erreichen.

Gibt es einen Zyklus von Ideen, bei dem alte Konzepte wie Sparse‑Modelle wiederkehren?

Ja. Viele Konzepte sind nicht linear zu beurteilen. Sparsity ist ein Beispiel: spars aktivierte Modelle erlauben enorme Kapazität (Trillionen von Parametern), während nur ein Prozent oder wenige Prozent der Parameter aktiviert werden. Das gibt die Möglichkeit, Erinnerungs‑ und Wissenskapazität zu erhöhen, ohne proportional viel Energie zu verbrauchen.

Wie messen Sie Erfolg intern? Reichen öffentliche Benchmarks?

Öffentliche Benchmarks sind nützlich, aber haben eine begrenzte Lebensdauer. Sobald ein Benchmark zu einfach wird — 95 Prozent und mehr — bringt weiteres Optimieren wenig. Deshalb arbeiten wir mit internen, gehaltenen Benchmarks, die garantiert nicht in den Trainingsdaten vorkommen. Die besten Benchmarks sollten anfänglich schwierig sein (zwei- bis dreißig Prozent), damit man echte Fortschritte messen kann.

Long‑Context: Reicht es, die Fenstergröße zu vergrößern?

Längere Kontextfenster helfen, aber rein quadratische Attention skaliert schlecht. Ein Kontext von 1 Million Tokens ist ein großer Schritt gegenüber 128k, aber nicht die Lösung für das Problem, das wir wirklich wollen: die Fähigkeit, wie „im Internet zu lesen“ zu attendieren. Statt einen direkten trillionen‑Token‑Attention zu bauen, wollen wir Pipelines, die sehr viele Kandidaten (z. B. 30.000 Dokumente) selektieren und dann stufenweise verfeinern, bis nur noch eine kleine Zahl wirklich relevanter Quellen bleibt.

Diese Pipeline ähnelt stark dem klassischen Retrieval‑System in Suchmaschinen. Das ist kein Zufall: Google’s ranking process hat seit den frühen 2000er Jahren immer eine initiale breite Stichprobe, gefolgt von schrittweiser Verfeinerung genutzt. Bei LLM‑basierten Systemen wird das Prinzip fortgeführt, aber mit anderen Mitteln: semantische Repräsentationen, LLM‑basierte Scoring‑Modelle und multimodale Indizes.

Wie sieht diese Pipeline konkret aus, wenn man Googles Ranking in einen LLM‑Stack übersetzt?

Konzepte aus Google’s ranking process lassen sich direkt übertragen:

- Große Index‑Stichprobe: zuerst sehr breit filtern (z. B. 30.000 Dokumente).

- Stufenweises Scoring: leichtere Modelle reduzieren die Menge (z. B. auf 117 Dokumente).

- Finale Aggregation: das leistungsstärkste Modell verarbeitet die kleine Menge und erzeugt das Ergebnis.

So wirkt ein System, das den Eindruck erweckt, es könne auf Billionen von Tokens achten, obwohl intern nur selektierte, relevante Subsets intensiv verarbeitet werden.

Warum ist Latenz so wichtig — und wie beeinflusst das die Modellstrategie?

Latenz ist ein erstes Klassenziel: Nutzererfahrung ändert sich dramatisch, wenn ein Modell 10–50x langsamer ist. Niedrige Latenz macht interaktive, mehrstufige Reasoning‑Workloads praktikabel. Flash‑Modelle sind deshalb so dominant: sie sind günstig genug, um breit in Gmail, YouTube oder der Sucherfahrung eingesetzt zu werden.

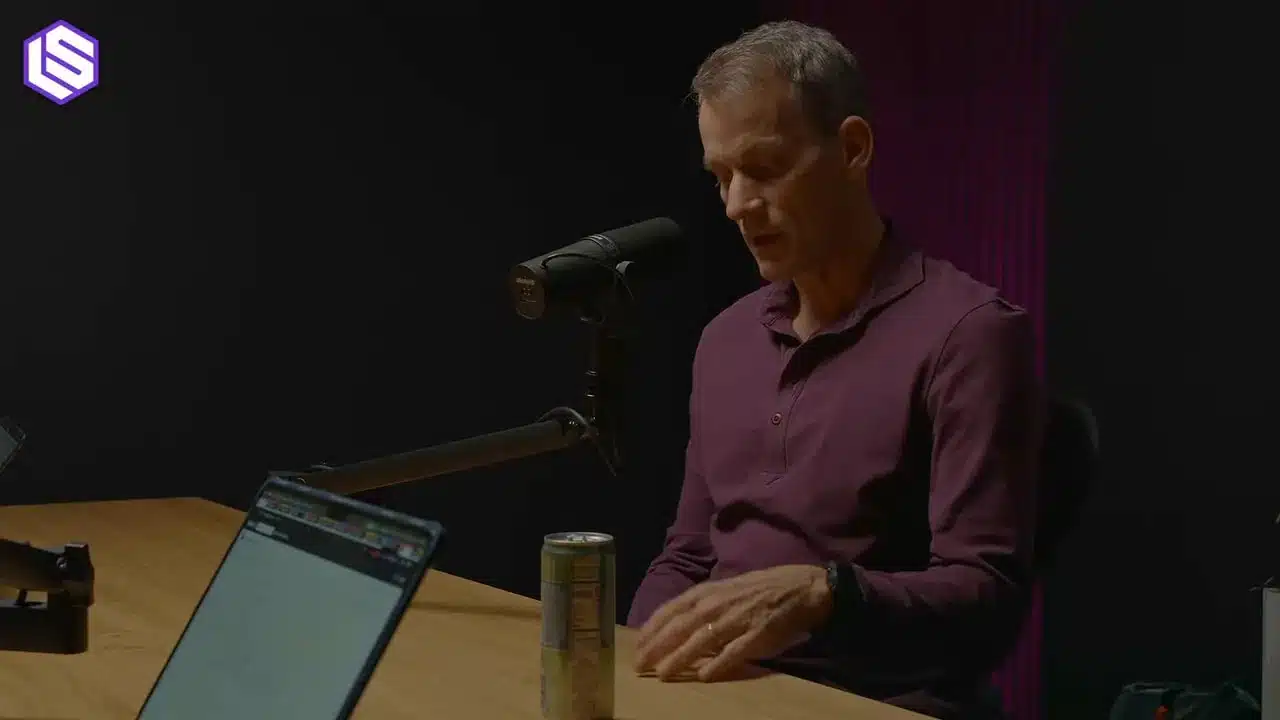

Wie denken Sie über Energie statt FLOPs, insbesondere picojoule‑Analysen?

Energie ist die bessere Metrik für Betriebskosten. Betrachten Sie Datenbewegung: ein Multiply kann sub‑1 picojoule kosten, während das Verschieben von Daten über den Chiptausendfach teurer sein kann. Das erklärt, warum Batching so zentral ist — man amortisiert die Kosten, die durch das Laden von Parametern entstehen. Aus Energieperspektive ist es also oft wichtiger, Datentransfers und Speicherhierarchie zu optimieren als reine Rechenleistung zu erhöhen.

Zusätzliche Techniken wie speculative decoding oder parallelisierte Vorhersagen erhöhen die effektive Batchgröße bei geringer Latenz‑Strafe und sind daher sehr attraktiv.

Wie wirkt sich das auf TPU‑Design und Hardware‑Co‑Design aus?

Hardwareteams und ML‑Forscher müssen vorausdenken. Ein Chip kommt nach zwei Jahren und hat in der Praxis eine Lebensdauer von drei bis fünf Jahren. Deshalb planen wir für TPU N+2. Manche Features sind spekulativ und nehmen nur wenig Platz ein, haben aber großes Upside, wenn sich Forschungstrends bestätigen. Dazu gehören höhere SRAM‑Kapazität, schnellere Interconnects, niedrigere Präzision und Unterstützung für sparsely activated layers.

Gibt es „Königsmodalitäten“ — also Formate, die alles andere kodieren können?

Video und Bewegung sind extrem reichhaltige Signale. Aus evolutionärer Sicht hat Sicht einen sehr hohen Signalwert. Video kodiert nicht nur Pixel, sondern Abläufe, Kausalität und Handlungskontexte. Das bedeutet nicht, dass andere Modalitäten überflüssig sind, aber Video plus Ton bietet hohe Bandbreite für viele Aufgaben. Multimodale Modelle, die Video, Audio, Sensorik (z. B. LiDAR) und domänenspezifische Modalitäten (z. B. medizinische Bilder) integrieren, sind sehr mächtig.

Wie kombinieren Sie allgemeine Modelle mit vertikalen Speziallösungen?

Basismodelle sollen breit und robust sein. Vertikale Modelle werden sinnvoll, wenn ein Bereich (zum Beispiel Robotik oder Healthcare) sehr spezifische Daten oder Spezialfähigkeiten erfordert. Praktisch ist ein modularer Ansatz: ein starkes Basismodell plus installierbare Domänenmodule oder Retrieval‑Pipelines, die bei Bedarf zugeschaltet werden. So erhält man das Beste aus beiden Welten: generalisiertes Reasoning und tiefes Domänenwissen.

Was ist mit Distillation und dem Problem, Wissen von großen Modellen in kleinere zu überführen?

Distillation ist ein Weg, um Fähigkeiten zu übertragen, ohne die Kosten großer Modelle dauerhaft zu tragen. Wichtig ist, dass das große Modell existiert; nur so können weiche Ziele erzeugt werden, die ein kleineres Modell effektiver erlernen kann als mit harten Labels. Beim Distillationsprozess müssen Selektivität und Datenauswahl stimmen, sonst werden Parameter der kleinen Modelle mit irrelevanten, seltenen Fakten vollgestopft.

Welche Rolle spielt Retrieval versus im‑Model Knowledge?

Ideal ist eine Trennung: rationales Reasoning bleibt im Modell, Fakten und lange‑tail Informationen kommen per Retrieval. Das reduziert den Bedarf an Parameterplatz für veränderliche Fakten, macht Modelle leichter zu aktualisieren und sorgt dafür, dass das begrenzte Parameterbudget für generalisierende Fähigkeiten genutzt wird.

Wie verändert AI das Programmieren und Pair‑Programming?

Coding‑Agenten werden immer besser. Entscheidend ist die Art der Interaktion: Manche Aufgaben fordern enge, iterative Zusammenarbeit; andere kann man an einen Agenten delegieren und später prüfen. Gute Spezifikationen werden wichtiger. Prompting ist letztlich Führungskommunikation: klare Vorgaben erhöhen die Qualität des Outputs dramatisch.

In Zukunft könnte man Hunderte von „virtuellen Interns“ strukturieren, die in kleinen Subteams arbeiten. Die menschliche Rolle verlagert sich stärker zur Koordination, Spezifikation und Validierung.

Welche Vorhersagen wollen Sie machen?

Zwei Kernaussagen:

- Personalisierte Modelle, die auf die persönlichen Daten einer Person (mit deren Einwilligung) zugreifen können, werden enorm nützlich. Das ist ein großer Hebel gegenüber generischen Modellen.

- Spezialisierte Hardware wird Latenzen deutlich reduzieren. Wenn wir in die Tausende oder Zehntausende Tokens pro Sekunde kommen, ändert sich, was technisch und UX‑seitig möglich ist.

Konkrete Lehren und Prinzipien

Einige praktikable Prinzipien aus Jeff Deans Erfahrung:

- Designparameter klar definieren: Queries/sec, Indexgröße, Updatefrequenz beeinflussen Architekturentscheidungen.

- Skalierung vorsichtig antizipieren: Plane für 5x–10x, aber erkenne wenn ein 100x‑Schritt ein komplett anderes Design nötig macht.

- Latenz und Energie zuerst: Energie pro Bit entscheidet oft über die Praxistauglichkeit einer Lösung.

- Modularität: Basisfähigkeiten breit halten, Spezialmodule ankoppelbar machen.

- Gute Benchmarks: Interne, nicht geleakte Tests sind Gold wert.

Fallstudie: Von Sharded Indexen zur In‑Memory‑Search

Ein historisches Beispiel: Anfang der 2000er hatte Google ein sharded Indexdesign mit Hunderten oder Tausenden Maschinen. Die Berechnung zeigte: eine Kopie des Index würde in den vorhandenen Arbeitsspeicher passen. Die Folge war, dass man die gesamte Indexdatenstruktur in Memory halten konnte. Das erhöhte die Flexibilität des Rankings massiv — ein Vorläufer dessen, was wir heute als semantische Retrieval in modernen LLM‑basierten Systemen sehen.

Schlussgedanken

Die nächste Epoche der KI ist kein einzelner Durchbruch, sondern das Zusammenspiel vieler Hebel: Hardware, sparsamer Aktivierung, Distillation, Retrieval, bessere Benchmarks und Integration multimodaler Signale. Wenn man diese Schichten sinnvoll kombiniert, entsteht echte Produktivität und Nutzen. Und am Ende bleibt ein Grundsatz: exakt definierte, gut strukturierte Spezifikationen — sei es für Systeme oder für Agenten — multiplizieren die Wirkung jeder Technologie.

FAQ

Wie beeinflusst Google’s ranking process die Architektur moderner LLM‑basierter Retrieval‑Pipelines?

Google’s ranking process liefert das Paradigma: breite erste Selektion, stufenweise Verfeinerung, finale Aggregation. Bei LLM‑Systemen bedeutet das, semantische Indizes und leichte Modelle zur initialen Filterung zu nutzen, danach stärkere Modelle für die finale Verarbeitung und Begründung.

Warum ist Distillation so wichtig für Flash‑Modelle?

Distillation ermöglicht, Wissen und Verhalten eines großen Frontier‑Modells in ein kleineres, kostengünstiges Modell zu übertragen. Die weichen Logits des großen Modells dienen als reichhaltigere Lernziele als harte Labels.

Was bedeutet die picojoule‑Analyse konkret für Entwickler?

Entwickler sollten Datentransfers minimieren, Batching und SRAM‑freundliche Layouts bevorzugen und bei der Modellierung den Energieaufwand als primäre Kostenkomponente betrachten — nicht nur FLOPs.

Werden spezialisierte vertikale Modelle langfristig überflüssig sein?

Nein. Breite Basismodelle gewinnen oft, aber vertikale Module oder Feinabstimmungen sind sinnvoll, wenn eine Domäne sehr spezielle Daten oder hohe regulatorische Anforderungen hat. Modularität ist der Schlüssel.

Wie kann ich meine eigenen Modelle energieeffizienter machen?

Nutze niedrigere Präzision, sparsity, speculative decoding und optimiere Speicherzugriffsmuster. Prüfe, welche Teile des Modells oft geladen werden und erhöhe deren Wiederverwendbarkeit durch Batching oder Caching.

Welche Rolle spielt Retrieval gegenüber internem Modellwissen?

Retrieval ist komplementär. Modelle behalten allgemeine Reasoning‑Fähigkeiten, während Faktenwissen und seltene Informationen per Retrieval eingeblendet werden. Das spart Parameterplatz und vereinfacht Aktualisierungen.

Gratis SEO Analyse

Lasse jetzt den kostenloser Website-Check von Thoka Network für Deine Homepage machen

Weiterführende Ressourcen

- Jeff Deans Arbeiten zu großflächigen neuralen Netzen, Distillation und sparsely activated models

- Publikationen zur TPU‑Architektur und hardware–software Co‑Design

- Artikel zu praktischen Implementierungen von Retrieval‑gestützten LLM‑Pipelines